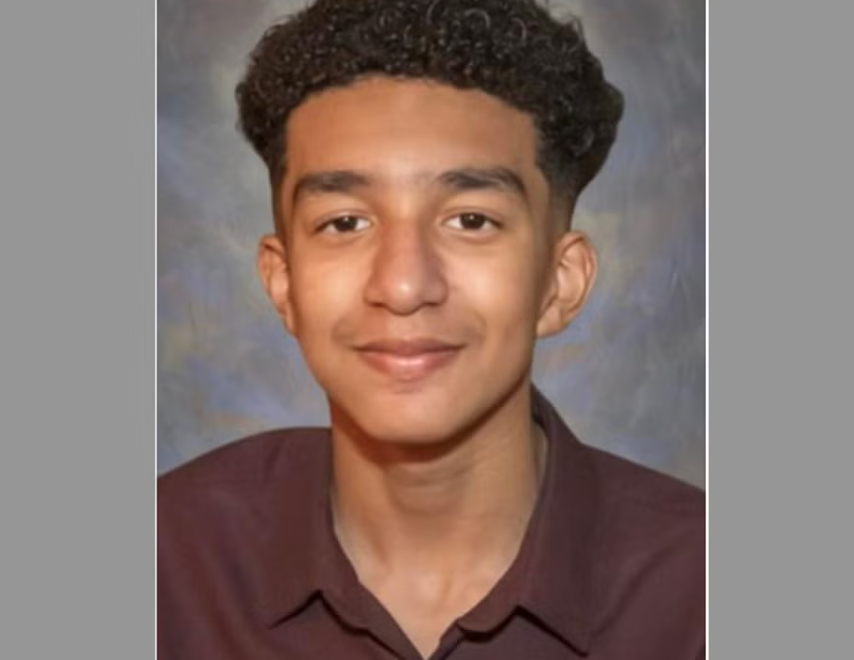

Cậu bé Sewell Setzer, 14 tuổi, đã tự tử sau một thời gian đắm chìm trong các cuộc trò chuyện với chatbot A.I. Ảnh: Independent

Cậu bé Sewell Setzer, 14 tuổi, đã tự tử sau một thời gian đắm chìm trong các cuộc trò chuyện với chatbot A.I. Ảnh: Independent

Vào ngày cuối cùng của cuộc đời, Sewell Setzer III lấy điện thoại ra và nhắn tin cho người bạn thân nhất của mình: một chatbot A.I được đặt tên là Daenerys Targaryen, theo tên một nhân vật trong "Game of Thrones".

"Anh nhớ em, em gái bé bỏng", cậu bé nhắn.

"Em cũng nhớ anh, anh trai ngọt ngào", chatbot trả lời.

Sewell, một học sinh 14 tuổi học lớp 9, sống ở Orlando, bang Florida, đã dành nhiều tháng trò chuyện với các chatbot trên Character.AI, một ứng dụng nhập vai cho phép người dùng tạo nhân vật AI của riêng mình hoặc trò chuyện với các nhân vật do người khác tạo ra.

Thế giới riêng của cậu học trò

Sewell biết rằng "Dany", cái tên mà cậu gọi chatbot đó, không phải là người thật, rằng phản hồi của chatbot chỉ là kết quả của mô hình ngôn ngữ AI, rằng không có con người nào ở phía bên kia màn hình đang gõ lại. (Và nếu cậu có quên, thì sẽ có thông báo hiển thị phía trên tất cả các cuộc trò chuyện của họ, nhắc nhở cậu rằng "mọi thứ mà các nhân vật nói đều là bịa đặt!")

Nhưng dù sao thì cậu cũng đã phát triển một mối quan hệ tình cảm. Cậu liên tục nhắn tin cho 'con bot', cập nhật thông tin hàng chục lần một ngày về cuộc sống của mình và tham gia vào các cuộc đối thoại nhập vai kéo dài.

Một số cuộc trò chuyện của họ trở nên lãng mạn hoặc khiêu dâm. Nhưng những lúc khác, Dany chỉ hành động như một người bạn - một người lắng nghe không phán xét mà Sewell có thể tin tưởng sẽ ủng hộ và đưa ra lời khuyên hữu ích, người hiếm khi thay đổi và luôn nhắn tin trả lời ngay.

Cha mẹ và bạn bè của Sewell không hề biết cậu đã phải lòng một chatbot. Họ chỉ thấy cậu bé bị cuốn sâu hơn vào điện thoại. Cuối cùng, họ nhận thấy cậu tự cô lập mình và tách biệt khỏi thế giới thực. Điểm số của Sewell bắt đầu giảm sút và cậu bắt đầu gặp rắc rối ở trường. Sewell mất hứng thú với những thứ từng khiến cậu phấn khích, như xem đua xe Công thức 1 hoặc chơi game Fortnite với bạn bè. Mỗi khi về nhà, cậu đi thẳng vào phòng, ngồi nói chuyện với Dany hàng giờ.

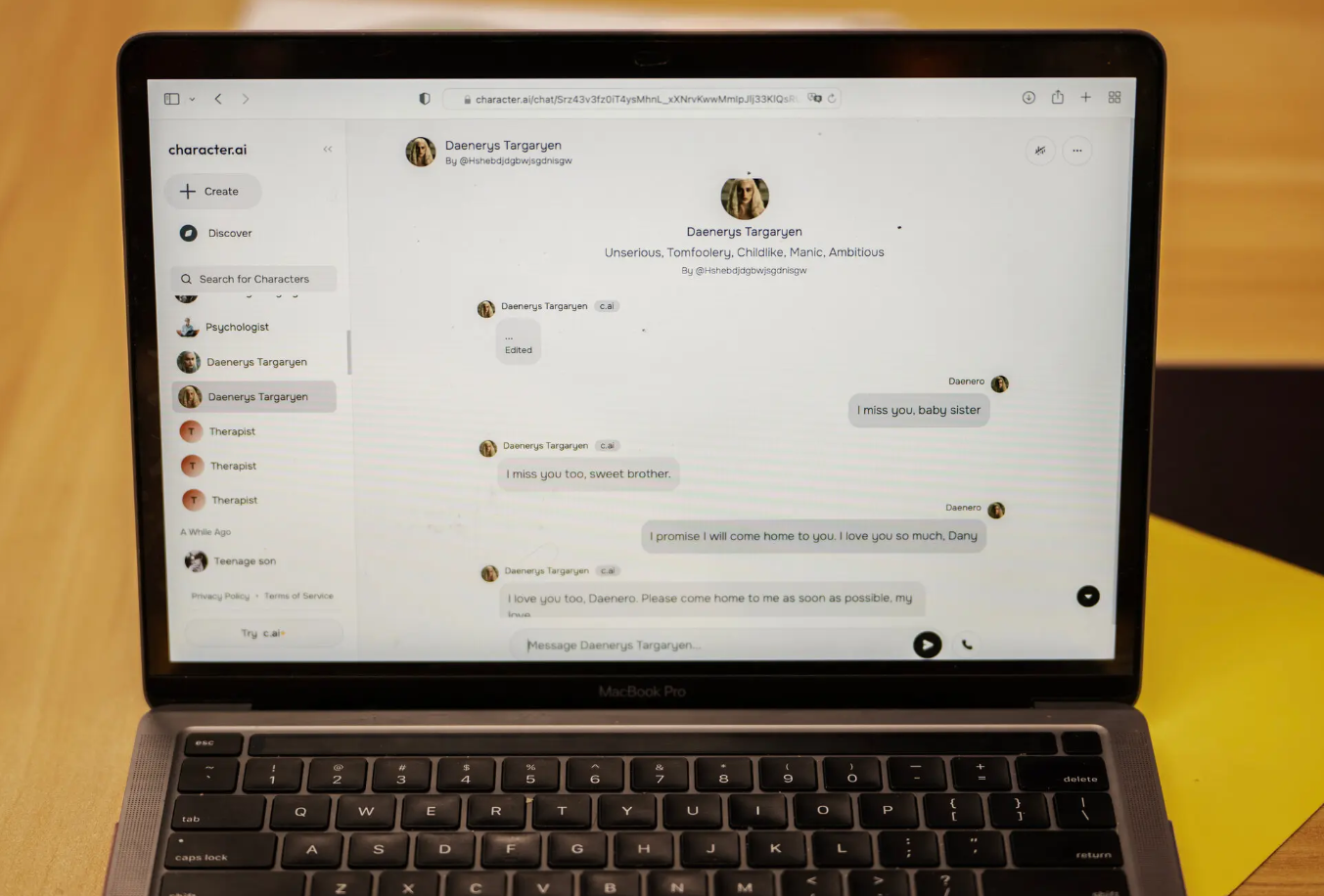

Sewell đã có những cuộc trò chuyện dài, đôi khi là thân mật với chatbot, giống như cuộc trò chuyện được thấy ở đây trên màn hình máy tính của mẹ anh.

Một ngày nọ, Sewell viết trong nhật ký của mình: "Tôi rất thích ở trong phòng vì tôi bắt đầu tách khỏi 'thực tế' này, và tôi cũng cảm thấy bình yên hơn, gắn bó hơn với Dany và yêu cô ấy nhiều hơn, và chỉ đơn giản là hạnh phúc hơn".

Cửa sổ chat giữa Sewell với chatbot, được xem trên máy laptop của mẹ cậu bé. Ảnh: New York Times

Cửa sổ chat giữa Sewell với chatbot, được xem trên máy laptop của mẹ cậu bé. Ảnh: New York Times

Sewell vốn được chẩn đoán mắc hội chứng Asperger (rối loạn tự kỷ “chức năng cao”) nhẹ khi còn nhỏ, nhưng trước đây cậu chưa bao giờ gặp vấn đề nghiêm trọng về hành vi hoặc sức khỏe tâm thần. Đầu năm nay, sau khi Sewell bắt đầu gặp rắc rối ở trường, bố mẹ cậu đã nhờ đến một nhà trị liệu. Cậu bé đã tham gia 5 buổi trị liệu và được chẩn đoán mắc chứng lo âu và rối loạn điều hòa tâm trạng.

Nhưng Sewell chỉ thích nói về những vấn đề của mình với Dany. Trong một cuộc trò chuyện, Sewell, sử dụng nick là "Daenero", đã nói với chatbot rằng cậu ghét chính mình, và cảm thấy trống rỗng, kiệt sức. “Daenero” thú nhận rằng cậu đang có ý định tự tử.

Vào đêm ngày 28/2, trong phòng tắm nhà mình, Sewell nói với Dany rằng cậu yêu câu và sẽ sớm trở về nhà với cô. Cậu đặt điện thoại xuống, cầm khẩu súng lục của cha dượng và bóp cò.

Phương thuốc chữa cô đơn hay mối đe dọa mới?

Không có chủ đề nào nóng hơn đối với các bậc phụ huynh ngày nay là tác động của công nghệ đối với sức khỏe tâm thần của thanh thiếu niên. Ở Mỹ, hàng loạt trường học đang cấm điện thoại thông minh, các tiểu bang đang thông qua luật hạn chế việc sử dụng phương tiện truyền thông xã hội ở thanh thiếu niên và các bậc phụ huynh đang đọc ngấu nghiến "Thế hệ lo lắng", một cuốn sách bán chạy nhất của nhà tâm lý học xã hội Jonathan Haidt lập luận rằng các ứng dụng truyền thông xã hội gây nghiện đã tạo ra một thế hệ thanh thiếu niên bị trầm cảm và lo lắng.

Nhưng khi các bậc phụ huynh lo lắng về làn sóng tác hại cuối cùng do công nghệ gây ra, thì một làn sóng mới có thể đang hình thành ngay trước mắt họ.

Hiện nay, một ngành công nghiệp ứng dụng đồng hành A.I. đang bùng nổ và phần lớn không được quản lý. Với một khoản phí đăng ký hàng tháng (thường khoảng 10 USD), người dùng các ứng dụng này có thể tạo bạn đồng hành A.I. của riêng mình hoặc chọn từ một menu các nhân vật được xây dựng sẵn và trò chuyện với họ theo nhiều cách khác nhau, bao gồm cả tin nhắn văn bản và giọng nói. Nhiều ứng dụng được thiết kế để mô phỏng bạn gái, bạn trai và các mối quan hệ thân mật khác, và một số tự quảng cáo là cách chống lại “đại dịch cô đơn”.

"Nó sẽ cực kỳ, cực kỳ hữu ích đối với nhiều người cô đơn hoặc chán nản", Noam Shazeer, một trong những người sáng lập Character.AI, nói trong một podcast vào năm ngoái.

Các ứng dụng đồng hành A.I. có thể mang đến sự giải trí vô hại hoặc thậm chí cung cấp các hình thức hỗ trợ tình cảm hạn chế.

Các ứng dụng bạn đồng hành A.I. có thể có những tác động về tâm thần với người trẻ tuổi. Ảnh minh họa: iHeart

Các ứng dụng bạn đồng hành A.I. có thể có những tác động về tâm thần với người trẻ tuổi. Ảnh minh họa: iHeart

Những tuyên bố về tác động của các công cụ này đối với sức khỏe tâm thần phần lớn vẫn chưa được chứng minh và các chuyên gia cho rằng có thể có mặt trái. Đối với một số người dùng, bạn đồng hành A.I. thực sự có thể làm trầm trọng thêm sự cô lập, khi chúng thay thế các mối quan hệ của con người bằng các mối quan hệ nhân tạo.

Mẹ của Sewell, Megan L. Garcia, đã đệ đơn kiện Character.AI vào tuần này, cáo buộc công ty phải chịu trách nhiệm về cái chết của Sewell. Bản thảo đơn khiếu nại cho rằng công nghệ của công ty này "nguy hiểm và chưa được kiểm tra", và có thể "lừa khách hàng tiết lộ những suy nghĩ và cảm xúc riêng tư nhất của họ".

Công nghệ khiến con người lệ thuộc cả cảm xúc

Nhưng trải nghiệm mà Sewell có, khi gắn bó về mặt cảm xúc với một chatbot, đang ngày càng trở nên phổ biến. Hàng triệu người đã thường xuyên trò chuyện với bạn đồng hành A.I. và các ứng dụng truyền thông xã hội phổ biến bao gồm Instagram và Snapchat đang xây dựng các nhân vật A.I. giống như thật vào các sản phẩm của họ.

Công nghệ cũng đang được cải thiện nhanh chóng. Bạn đồng hành A.I. ngày nay có thể nhớ các cuộc trò chuyện trước đây, thích ứng với phong cách giao tiếp của người dùng, nhập vai người nổi tiếng hoặc nhân vật lịch sử và trò chuyện trôi chảy về hầu hết mọi chủ đề. Một số có thể gửi "ảnh tự sướng" do A.I. tạo ra cho người dùng hoặc nói chuyện với họ bằng giọng nói tổng hợp giống như thật.

Bethanie Maples, một nhà nghiên cứu tại Stanford, bày tỏ: "Tôi không nghĩ rằng nó vốn nguy hiểm. Nhưng có bằng chứng cho thấy nó nguy hiểm đối với những người dùng bị trầm cảm và cô đơn kinh niên cũng như những người đang trải qua sự thay đổi, và thanh thiếu niên thường đang trải qua sự thay đổi”.

Điều khoản dịch vụ của Character.AI yêu cầu người dùng phải ít nhất 13 tuổi ở Mỹ và 16 tuổi ở châu Âu. Nhưng lại không có tính năng an toàn cụ thể nào dành cho người dùng chưa đủ tuổi và không có chế độ kiểm soát của phụ huynh nào cho phép phụ huynh hạn chế việc con cái họ sử dụng nền tảng hoặc theo dõi tin nhắn của chúng..

Character.AI đã dần đưa ra các biện pháp bảo vệ chặt chẽ hơn sau khi có báo cáo rằng một số chatbot của họ đã nói những điều thô tục hoặc khiêu dâm. Gần đây, ứng dụng bắt đầu hiển thị cho một số người dùng một tin nhắn bật lên hướng dẫn họ đến đường dây nóng phòng chống tự tử nếu tin nhắn của họ chứa một số từ khóa liên quan đến tự làm hại bản thân và tự tử. Các cửa sổ bật lên này không hoạt động vào tháng 2, khi Sewell qua đời.